「MediaPipe」は、Google社が提供するライブストリーミングのためのオープンソースのML(機械学習)ソリューションです。 このMediaPipeを利用すると高性能なAI画像処理アルゴリズムを利用したARアプリケーション等を簡単に作成できます。 クロスプラットフォームであり、主要なOSに実装することが可能です。

MediaPipeでできること

Selfie Segmentation

セルフィーセグメンテーションは、シーン内の目立つ人間をセグメント化します。スマートフォンとラップトップの両方でリアルタイムに実行できます。想定しているユースケースは、人物がカメラに近い(2m未満)自撮り効果やビデオ会議などです。

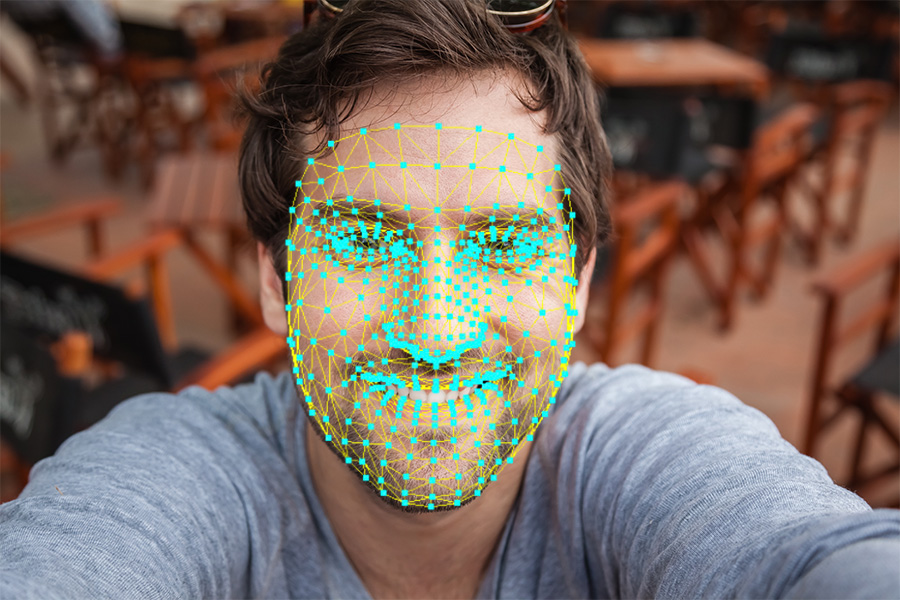

Face Mesh

Face Meshは、モバイル端末でもリアルタイムに468個の3D顔ランドマークを推定する顔形状ソリューションです。機械学習(ML)を用いて3D表面形状を推定するため、専用の深度センサーを必要とせず、1回のカメラ入力で済みます。軽量なモデル・アーキテクチャとパイプライン全体のGPUアクセラレーションを活用することで、このソリューションはライブ体験に不可欠なリアルタイム・パフォーマンスを実現します。

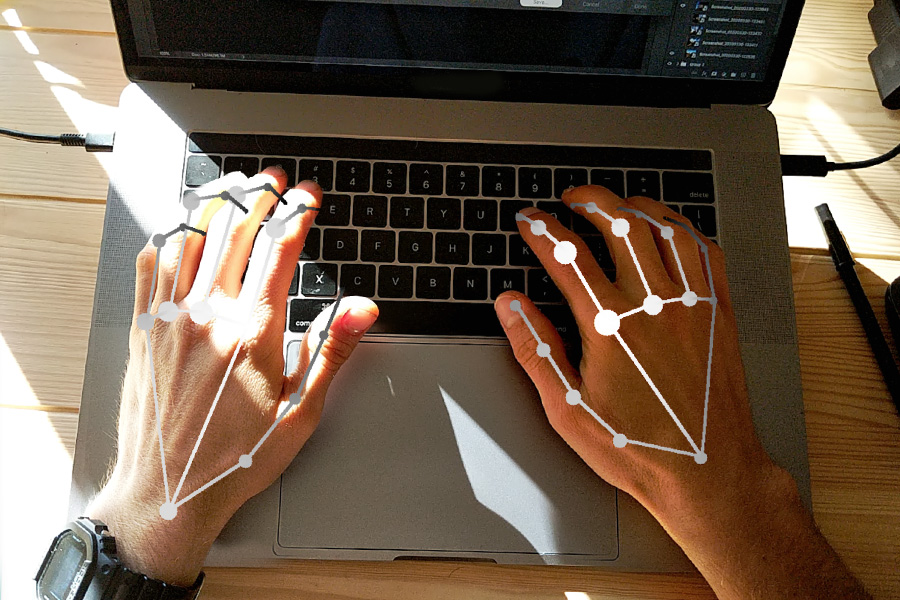

Hand Tracking

手の形や動きを認識する能力は、さまざまな技術領域やプラットフォームにおいて、ユーザーエクスペリエンスを向上させるために不可欠な要素になり得ます。例えば、手話の理解やハンドジェスチャーの制御の基礎となるほか、拡張現実(AR)において物理世界の上にデジタルコンテンツや情報を重ね合わせることも可能になります。手指は、指や手のひらで隠れることが多く、また、コントラストに乏しいため、人間にとって自然なことではありますが、リアルタイムでしっかりと手を認識することは、コンピュータビジョンのタスクとしては明らかに困難なものです。

Human Pose Detection and Tracing

映像からの人物ポーズ推定は、身体運動の定量化、手話認識、全身ジェスチャー制御など、様々なアプリケーションで重要な役割を担っています。例えば、ヨガ、ダンス、フィットネスなどのアプリケーションの基礎を形成することができる。また、拡張現実(Augmented Reality)において、物理的な世界の上にデジタルコンテンツや情報を重ね合わせることも可能です。

Hair Segmentation

超リアルなリアルタイムヘアーカラーリング

Object Detection and Tracking

Box Trackingソリューションは、ビデオやカメラのストリームから画像フレームを消費し、タイムスタンプで開始ボックスの位置を示し、追跡する2Dの関心領域を示し、各フレームの追跡ボックスの位置を計算するものです。このユースケースでは、開始ボックスの位置はオブジェクト検出から得られますが、開始位置はユーザーや他のシステムから手動で提供することも可能です。このソリューションは、モーション解析コンポーネント、フローパッケージャーコンポーネント、ボックストラッキングコンポーネントの3つの主要コンポーネントで構成されています。各コンポーネントはMediaPipe計算機としてカプセル化されており、全体としてのボックストラッキングソリューションはMediaPipeサブグラフとして表現されます。

Face Detection

Face Detectionは、6つのランドマークとマルチフェイスをサポートする、超高速顔検出ソリューションです。BlazeFaceをベースにしており、モバイルGPU推論用に調整された軽量で性能の良い顔検出器です。この検出器の超リアルタイム性能により、3D顔キーポイントやジオメトリ推定(MediaPipe Face Meshなど)、顔特徴や表情分類、顔領域分割など、他のタスク固有のモデルの入力として正確な顔関心領域を必要とするあらゆるライブビューファインダー体験に適用することが可能です。

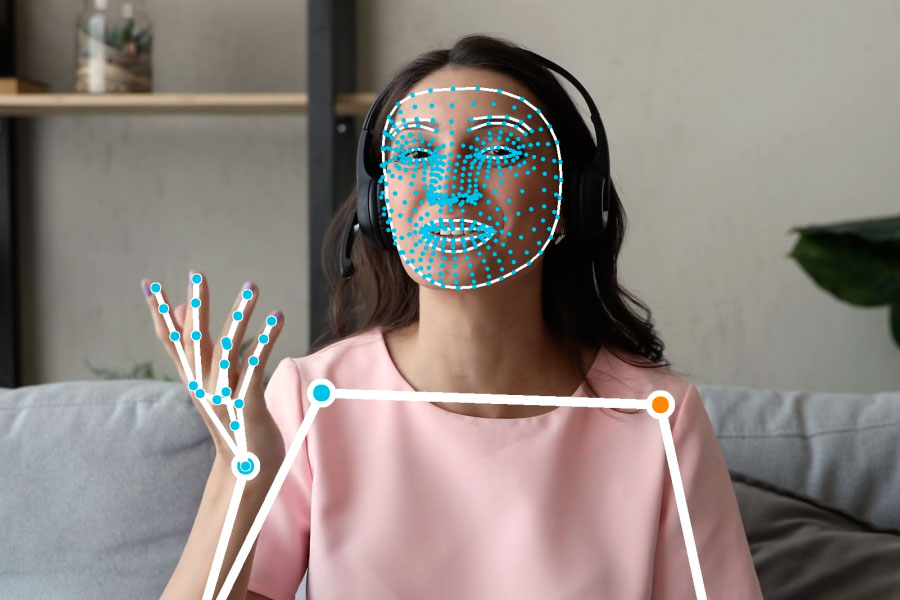

Holistic Tracking

人間のポーズ、顔のランドマーク、ハンドトラッキングをモバイルデバイス上でリアルタイムに同時認識することで、フィットネスやスポーツ分析、ジェスチャーコントロールや手話認識、拡張現実の試着や効果など、様々な現代生活のアプリケーションを実現することができます。メディアパイプは、これらのタスクに対して、高速かつ高精度なソリューションをすでに提供しています。これらをリアルタイムで組み合わせ、意味的に一貫性のあるエンドツーエンドのソリューションを実現するには、依存関係にある複数のニューラルネットワークを同時に推論する必要があり、他に類を見ない難しい問題です。

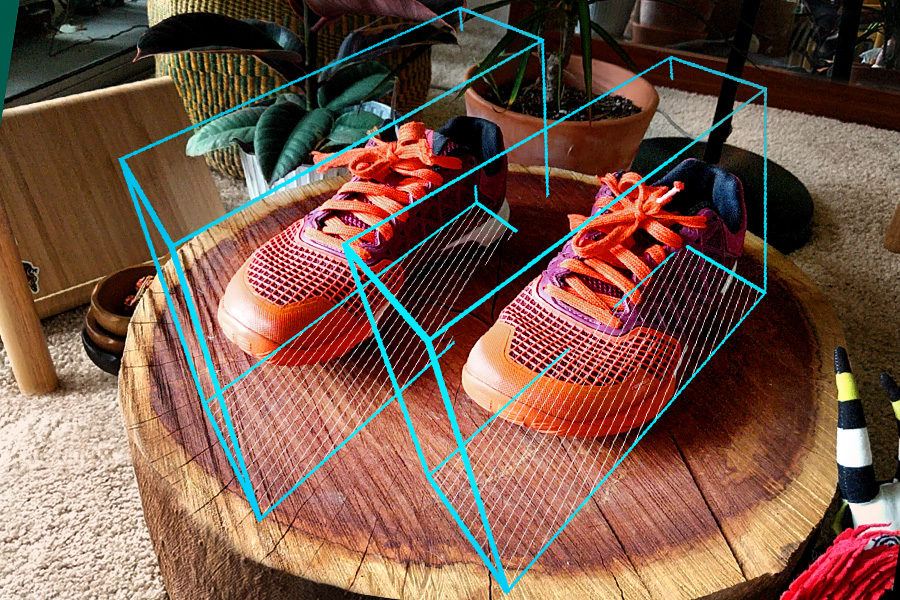

3D Object Detection

Objectronは、日常的に使用する物体のためのモバイルリアルタイム3D物体検出ソリューションです。2D画像から物体を検出し、Objectronのデータセットで学習した機械学習(ML)モデルにより、その姿勢を推定することができます。

And More Solutions

モバイル(Android/iOS)、デスクトップ/サーバー、Edge TPUでMediaPipeを実行する方法については、コードサンプルをご覧ください。

コメント